Cerebras —— 请给我更快的Token

自2021年6月Dylan为新闻通讯专门撰写关于Cerebras的文章以来,已经过去了将近5年。他在两天内就发布了4篇文章!这些文章可以轻松阅读,但时代已经变了。

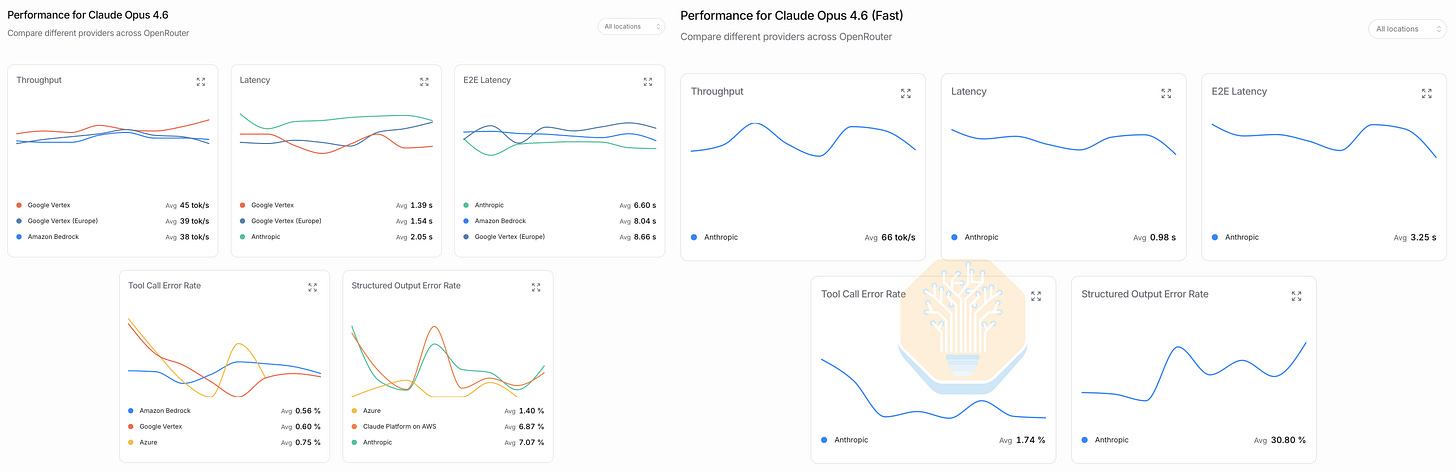

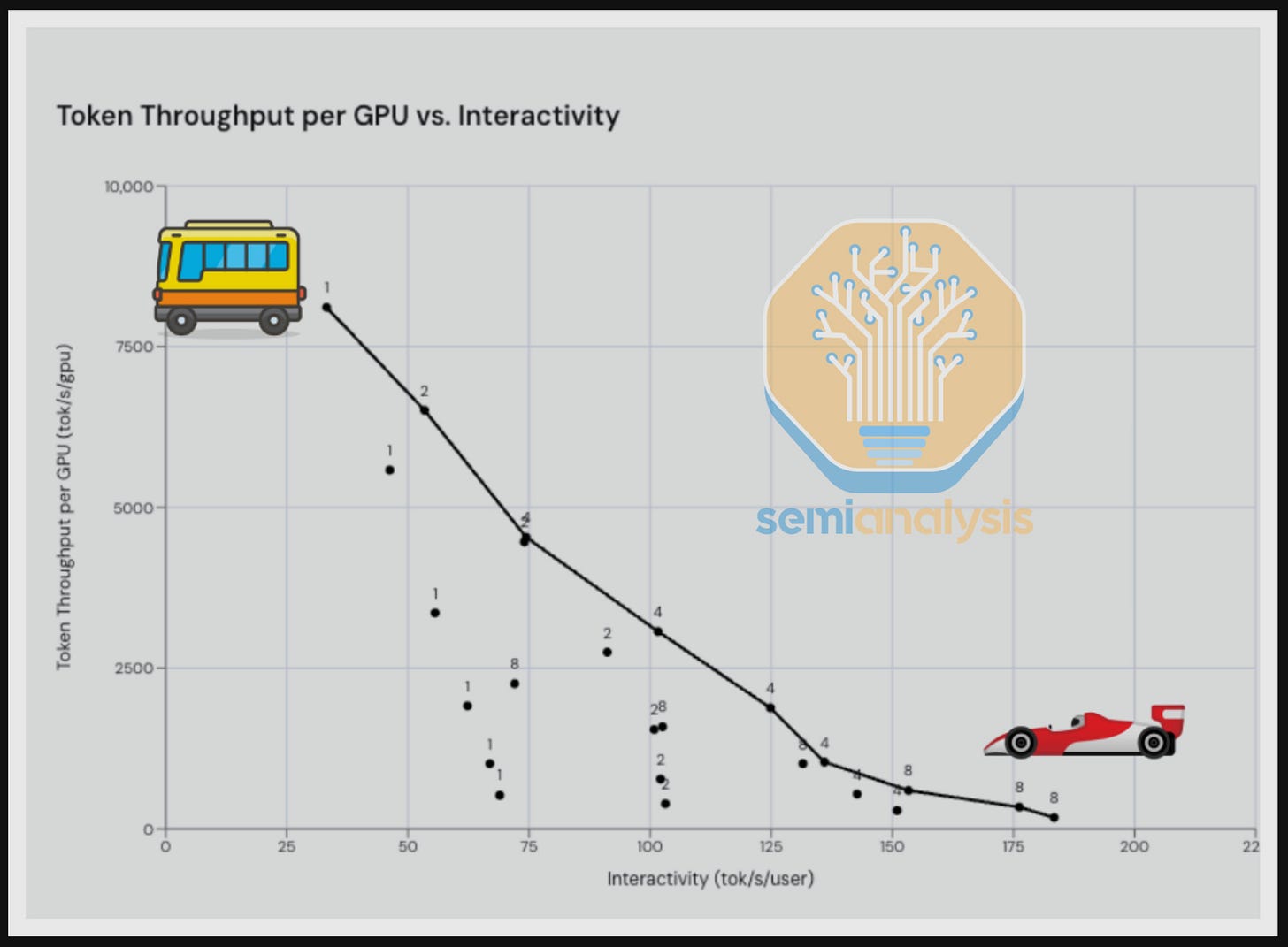

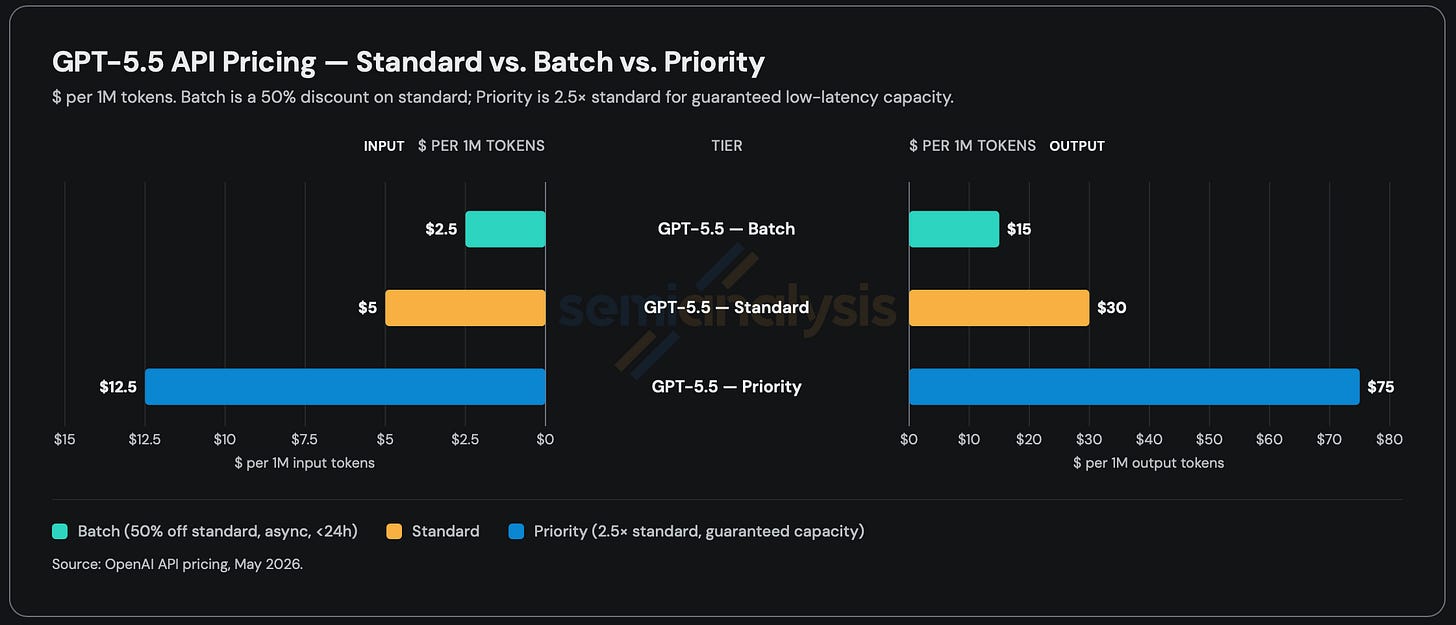

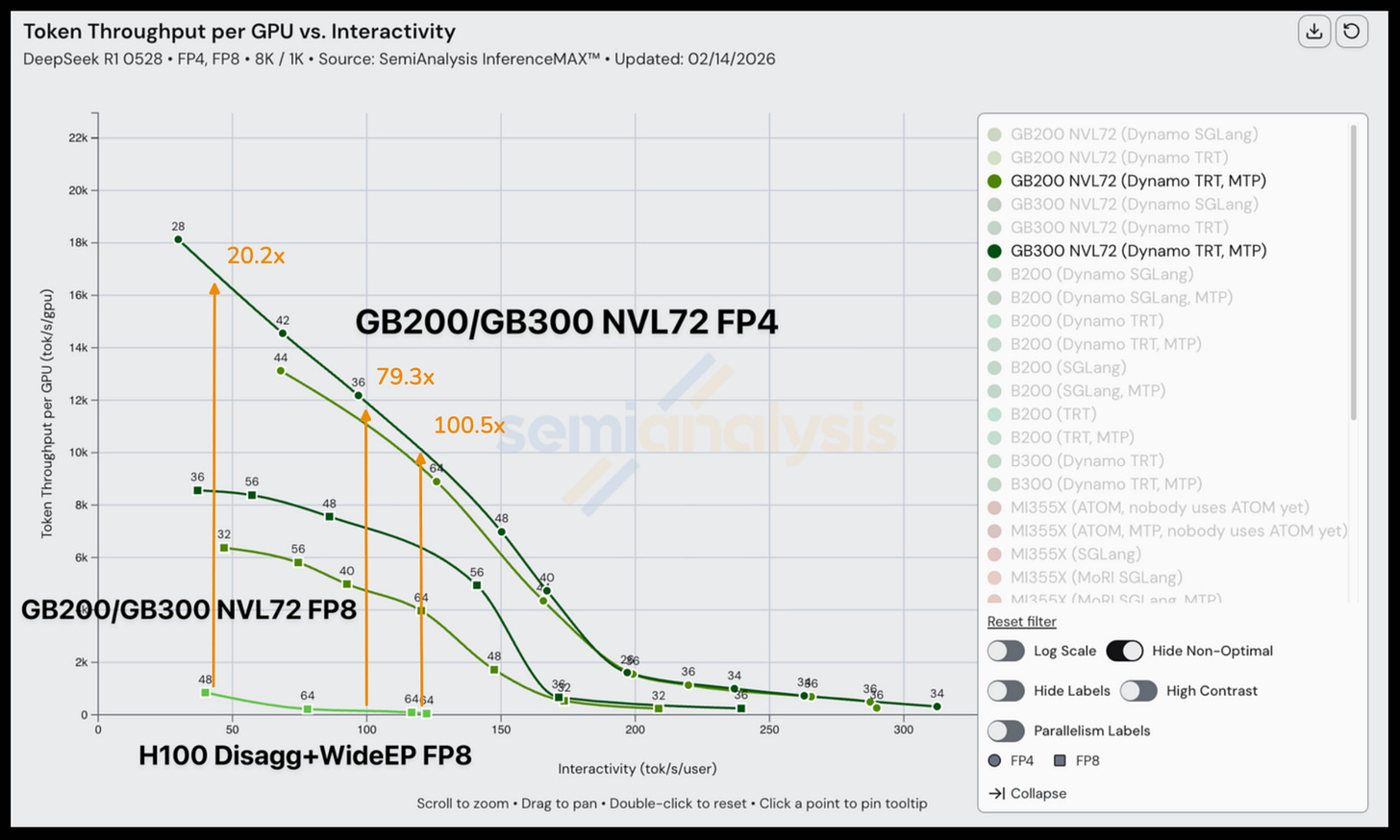

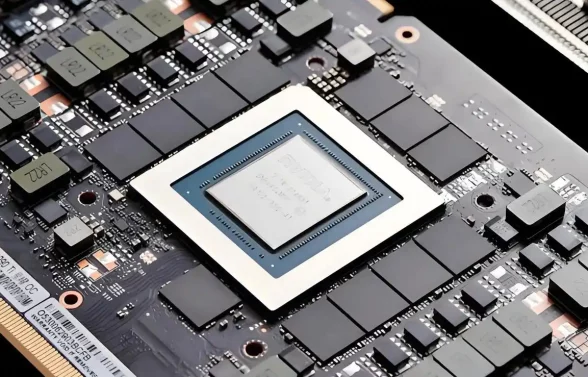

改变的另一个方面是Cerebras的运势。随着快速token技术成为主流,以及与OpenAI达成的750MW计算交易,Cerebras已经准备好接受公众市场的审视。直到6个月前,我们仍然认为晶圆规模引擎(Wafer Scale Engine)尽管有其大胆的创新,但仍存在一些难以掩盖的技术弱点。因此,基于HBM的加速器(如GPU和TPU)仍然广受欢迎。Cerebras的优势(主要是速度)多年来一直被忽视,人们更关注总吞吐量。但现在,随着前沿实验室发布同一模型权重的快速、优先、标准和批处理层级,世界通过他们的钱包揭示了他们对快速token的偏好。这使Cerebras的优势凸显出来,也是OpenAI愿意为Cerebras的计算能力支付数百亿美元的关键原因。需求如此强劲,让每个人都看起来很出色。

今天,在Cerebras即将IPO之际,并且因为我们热爱晶圆技术,我们发布了一篇相当于4篇普通文章长度的文章。在文章中,我们将深入探讨:

- 快速推理

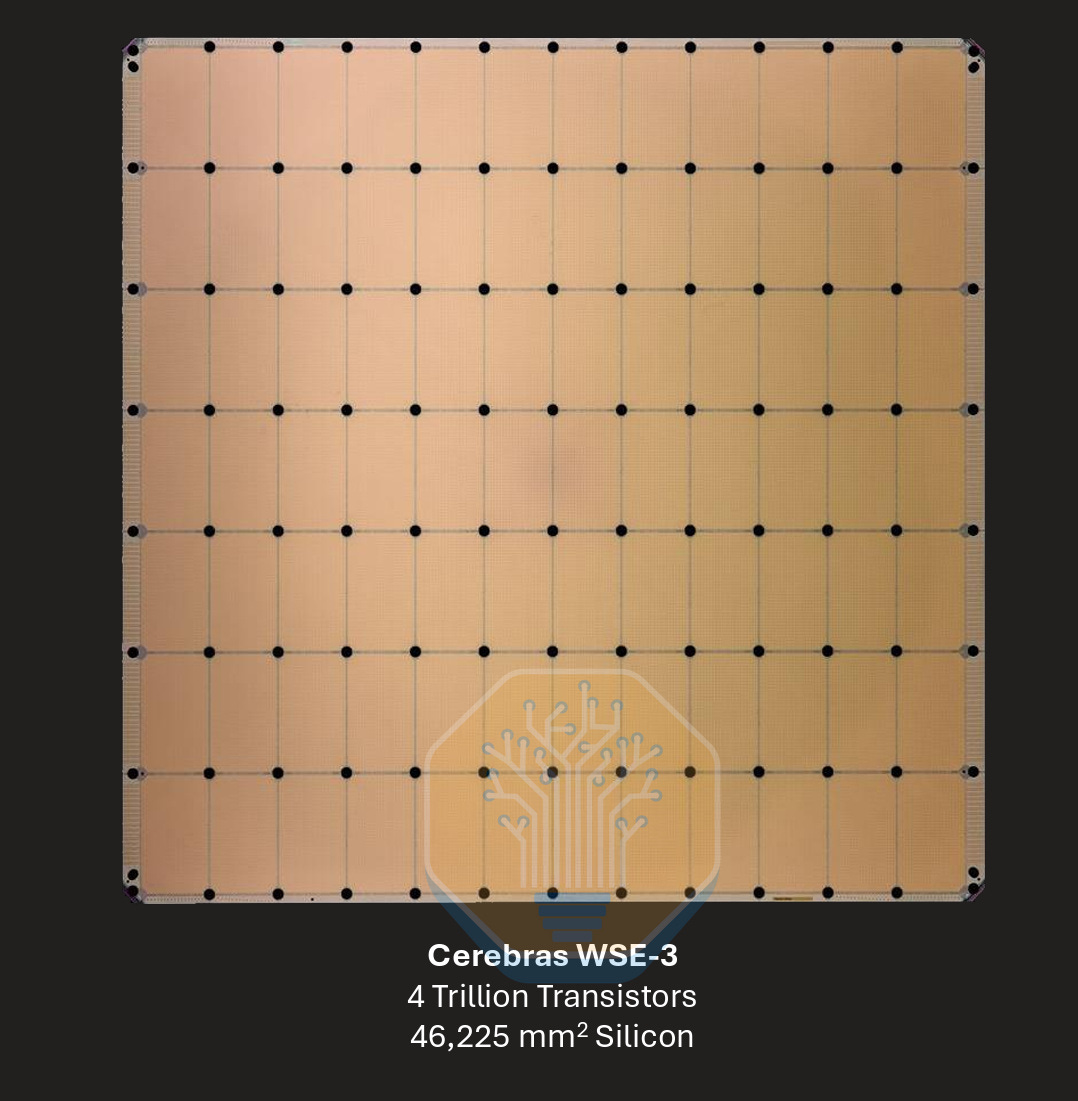

- WSE-3,Cerebras独特的晶圆规模芯片

- CS-3,Cerebras的系统及其独特架构

- 提供物料清单(BOM)成本分析

- 解释晶圆技术在何时以及如何赢得快速推理的优势

- 描述晶圆技术的一些局限性,展示权衡取舍

对于付费订阅者,我们还展示了改变公司命运的OAI推理交易的经济性,并分享了我们关于Cerebras在成为新云(neocloud)方面的进展见解(即他们如何在2028年前为OpenAI获得所需的750MW)。此外,我们将讨论Cerebras的未来计划,将晶圆规模光收发器与他们的WSE计算引擎进行混合键合,他们声称这样做纯粹是出于对技术的热爱,因为这对于LLM推理并非必需,但对于HPC(高性能计算)”婴儿潮”工作负载是必需的。这些HPC客户在NVIDIA基本上取消了GPU上的FP64原生硬件后,实际上已被NVIDIA抛弃。

速度的需求

快速推理已经到来。

虽然SemiAnalysis历史上一直讨厌SRAM(静态随机存取存储器)机器,但这一切在2025年12月NVIDIA收购Groq时发生了变化。显然,Jensen看到了至少200亿美元的价值,并且在几个月后我们达到Claude代码拐点时,他被证明是正确的。现在,晶圆技术将在这里立足。

许多人(包括Andrej Karpathy)以前认为原始智能/能力比速度重要得多,但我们揭示的偏好最终证明有时情况恰恰相反。在智能达到某个阈值后,开发者更倾向于选择更快的token而非更智能的token。在一个AI几乎涉及您工作流程每个方面的世界里…

原文链接:https://newsletter.semianalysis.com/p/cerebras-faster-tokens-please

关注微信号:智享开源 关注微博:IMCN开源资讯网 ,可及时获取信息

为你推荐

还没有任何评论,你来说两句吧!